NEWS

De la réalité à la réalité virtuelle : l’IA qui transforme vos objets en modèles 3D instantanément

L’IA qui fait le pont entre le réel et la VR : transformation instantanée d’objets en modèles 3D

La transformation instantanée d’une photo en modèles 3D n’a plus rien d’un tour de magie. La nouvelle vague d’intelligence artificielle dédiée à la numérisation 3D, popularisée par l’approche de SAM 3D chez Meta, promet de convertir des clichés uniques en objets 3D manipulables directement en réalité virtuelle. Cette innovation technologique dépasse la photogrammétrie traditionnelle, longtemps dépendante de séries d’images et de calculs lourds.

Le principe est simple à décrire, ambitieux à réussir : l’IA détecte l’objet, reconstruit son volume, infère les zones cachées, génère une texture crédible et livre un maillage prêt à l’emploi. Là où les pipelines classiques réclamaient des dizaines d’angles et des heures de nettoyage, la modélisation automatique réduit l’entrée à une seule image et le temps à quelques secondes. Résultat : import plus rapide dans un moteur VR, essais créatifs accélérés et itérations plus fréquentes.

Dans un studio indépendant, cet accès direct change la donne. Un accessoire scanné le matin peut déjà être intégré l’après-midi dans une scène interactive. Pour un musée virtuel, une vitrine entière d’objets peut être enrichie sans passer par un prestataire 3D. La démocratisation est réelle, et le public curieux peut s’y essayer avec des casques grand public et des guides pratiques comme une sélection de jeux VR accessibles ou des articles d’accompagnement tels que activer le mode développeur et connecter son casque à un PC.

Pourquoi cette approche bouscule les usages

La nouveauté ne se limite pas à la vitesse. En combinant des millions d’images annotées et des validations humaines, l’IA apprend à “compléter” ce que la photo ne montre pas. Elle devine des symétries, préserve des proportions et évite les trous lors du texturage. Même un objet partiellement occulté gagne une cohérence globale suffisante pour l’exploration en VR.

- 🚀 Gain de temps : du cliché à la scène VR en quelques secondes.

- 🧠 Compréhension sémantique : l’IA distingue forme, matière et détails essentiels.

- 🛠️ Moins de post-traitement : retouches limitées avant l’intégration.

- 🎮 Prêt pour les moteurs VR : export compatible et rapide vers Unity/Unreal.

- 🌐 Polyvalence : utile en réalité augmentée, e-commerce, formation et jeu.

Pour les curateurs d’expériences, la perspective est claire : montrer, tester, partager, puis affiner. On retrouve cette logique d’itération agile dans des expériences locales et culturelles où la VR modernise la narration, à l’image des initiatives régionales comme l’exploration du passé minier en VR ou des offres de loisirs comme les salles de réalité virtuelle à Tarbes.

| Aspect clé ✨ | Avant (photogrammétrie) 🕰️ | Aujourd’hui (IA) ⚡ |

|---|---|---|

| Nombre d’images | 20–200 photos | 1 photo |

| Temps de traitement | Minutes à heures | Secondes |

| Nettoyage | Élevé, manuel | Faible, semi-automatique |

| Qualité texture | Très bonne si studio | Bonne en conditions variées |

| Compatibilité VR | Préparation requise | Export direct le plus souvent |

Insight final : la valeur ne vient pas seulement de la vitesse, mais de l’effet cumulatif d’essais rapides qui alimentent la créativité et réduisent le coût d’échec.

Du cliché au moteur VR : pipeline de numérisation 3D simplifié pour objets 3D

Dans un studio fictif, Studio Luciole, la créatrice XR Élise doit intégrer un vase ancien dans un escape game. Le flux numérisation 3D par IA condense la chaîne de production : capture mobile, modélisation automatique, vérification du maillage, import dans le moteur, tests sur casque, publication. L’objectif : accélérer sans sacrifier la crédibilité visuelle.

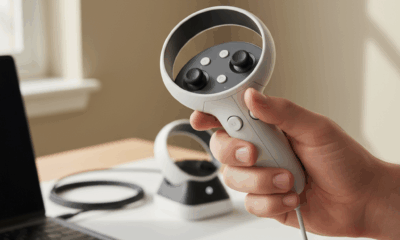

Pour celles et ceux qui démarrent, un casque autonome comme le Quest gagne en polyvalence en activant le mode développeur. Les guides mode développeur Oculus et réinitialiser un Quest 2 aident à tenir un environnement propre pour tester des scènes d’objets importés. Un câble de lien stable comme décrit dans quel câble pour Quest 2 facilite le debug sur PC.

Étapes recommandées et bonnes pratiques

Le pipeline suivant fonctionne bien sur des prototypes et des démos publiques. En phase bêta, chaque étape gagne à être mesurée, car l’IA peut halluciner des détails sous-contrôlés.

- 📸 Capture : photo nette, lumière diffuse, fond uniforme.

- 🧩 Délimitation : sélection précise de l’objet dans l’image.

- 🧱 Génération : lancer l’IA (type SAM 3D) et récupérer mesh + texture.

- 🧼 Nettoyage : suppression de polygones isolés, UV check.

- 🎛️ Optimisation : LOD, lightmaps, occlusion baking si nécessaire.

- 🎮 Tests VR : vérification échelle, collisions, prise en main.

Les optimisations PC restent cruciales pour la fluidité, surtout si la scène accumule des objets générés. Astuces utiles dans améliorer les performances d’un PC. Pour les studios qui ciblent plusieurs devices, les compatibilités PSVR sont à anticiper via brancher un casque VR à une PS4 ou paramétrer une manette PS4 en VR.

| Étape 🔁 | Outil conseillé 🛠️ | Contrôle qualité ✅ |

|---|---|---|

| Capture | Smartphone HDR | Grain faible, ombres douces |

| Génération IA | SAM 3D / équivalent | Volume cohérent, pas de trous |

| Nettoyage | Blender/MeshLab | Normales correctes, UV non chevauchées |

| LOD/Optim | Decimate/Simplygon | FPS stable en VR |

| Intégration | Unity/Unreal | Échelle 1:1, collisions OK |

Pour visualiser des démonstrations similaires, une recherche vidéo aide à situer les différences de rendu et d’ergonomie entre solutions.

Les tests utilisateurs, même informels, révèlent vite l’importance de l’échelle perçue et de la texture. Avant d’intégrer massivement des objets, mieux vaut réaliser un micro-escape jouable sur une scène pour valider les sensations.

Photogrammétrie vs IA générative : la modélisation automatique change-t-elle la donne ?

La photogrammétrie a longtemps tenu le haut du pavé : qualité, fidélité, standards établis. L’IA la bouscule avec des atouts de vitesse et de flexibilité. La question n’est pas de remplacer, mais de combiner : scènes patrimoniales ultra-détaillées en photogrammétrie, accessoires et props en modélisation automatique pour une mise en scène rapide.

Les bases d’apprentissage massives et l’évaluation humaine donnent à l’IA une compréhension structurelle des objets : symétries, arêtes fonctionnelles, volumétrie plausible. Dans la pratique, l’IA reconstitue mieux que prévu les zones hors champ, mais peine encore sur les matériaux complexes (transparences, brillances, micro-reliefs).

Ce qui change concrètement pour la production

Dans une verticalité “jeu + escape game”, le gain se voit sur le time-to-scene. Élise, chez Studio Luciole, génère trois variantes d’un même artefact pour un puzzle. En 20 minutes, les trois versions sont jouables, quand le pipeline classique aurait pris l’après-midi. L’économie ne concerne pas seulement la main d’œuvre, mais la possibilité d’itérer narrativement.

- ⚡ Vitesse : props simples en quelques secondes, idéal pour prototypage.

- 🧭 Souplesse : ajout ou retrait d’un détail sans tout rescanner.

- 🧪 Expérimentation : A/B tests de formes et textures en VR.

- 🔍 Limites : finesse des détails, matériaux spéciaux, bords translucides.

- 🔒 Contrôle : nécessité d’une passe qualité avant livraison.

| Critère 🧮 | Photogrammétrie 🖼️ | IA 1-photo 🤖 |

|---|---|---|

| Détails fins | Excellents en studio | Corrects, parfois lissés |

| Scènes encombrées | Sensible au bruit | Étonnamment robuste |

| Coût initial | Équipement/captures | Faible, smartphone + IA |

| Temps d’itération | Long | Très court |

| Réalité augmentée | Préparation d’assets | Prêt à placer rapidement |

Une piste intéressante consiste à hybrider : on génère vite, puis on retouche certains objets à forte valeur esthétique. Des acteurs spécialisés dans l’avatar et l’animation comme Meshcapade affinent ce continuum, en simplifiant la création d’avatars réalistes utiles dans les hubs sociaux et les jeux. Les curieux des expériences narratives peuvent aussi explorer des formats culturels, par exemple une immersion à Lyon dans l’univers d’Astérix, pour ressentir l’impact d’assets bien intégrés.

Insight final : la bonne question n’est pas “quelle méthode est la meilleure ?”, mais “à quel moment basculer de l’IA rapide à la capture exhaustive selon l’enjeu artistique”.

Cas d’usage en VR/AR : du jeu aux entreprises, l’IA libère la créativité

Dans les jeux et escape games, la génération d’objets 3D à partir d’images introduit une “culture du test”. Un puzzle peut naître d’un objet photographié chez soi et prendre vie en quelques minutes dans une salle virtuelle. Les hubs sociaux imaginent des vitrines partagées : on montre un objet réel, on le manipule, on en discute, le tout en réalité virtuelle.

Les entreprises y trouvent un gain opérationnel. Catalogue produits pour la formation, simulations de maintenance, mise en contexte d’équipements en réalité augmentée sur site. Les responsables innovation comparent les casques, les coûts et les usages avec des synthèses comme la réalité mixte en entreprise. Les activités sportives ou de santé, comme la boxe en VR, démontrent la richesse des interactions et la nécessité d’assets optimisés, à l’image de séances de boxe en réalité virtuelle.

Exemples concrets et inspirations

Dans une expérience culturelle, un musée virtuel reconstitue une vitrine de céramiques. L’IA génère les volumes à partir de photos d’archives. Le conservateur ajuste seulement les matières brillantes. Dans l’éducation, un labo de lycée importe des instruments de physique scannés par l’enseignant pour une manipulation sécurisée. Côté loisirs, des villes et sites historiques s’emparent du sujet avec des visites et ateliers.

- 🏛️ Patrimoine : vitrines interactives de musées, visites guidées commentées.

- 🏭 Industrie : préparation d’interventions, formation par simulation.

- 🛒 E-commerce : essais produits en RA, visualisation à domicile.

- 🎓 Éducation : manipulations virtuelles d’objets sensibles.

- 🎬 Culture : films et sélections de films VR enrichis par accessoires scannés.

| Usage 🎯 | Bénéfice principal 🏆 | Point de vigilance ⚠️ |

|---|---|---|

| Jeux/escape | Itération rapide sur gameplay | Échelle et collisions à vérifier |

| Formation | Réalité terrain à faible risque | Textures fidèles à l’outil réel |

| Musées | Accessibilité et médiation | Droits d’images et crédibilité |

| E-commerce | Projection en RA/VR | Couleurs et matériaux exacts |

| Sport/santé | Engagement et données | Latence, sécurité de l’espace |

Pour approfondir, Explorer une recherche vidéo est utile pour comparer les workflows et la qualité des rendus.

Insight final : l’IA ne remplace pas l’intention artistique ni le sens pédagogique, elle donne juste plus d’occasions de tester vite et de garder le meilleur.

Qualité, limites et stratégies d’amélioration en 2025

Les équipes qui embrassent cette technologie immersive butent sur quatre écueils : résolution des textures, détails de géométrie, interactions physiques et cohérence d’échelle. SAM 3D progresse vite, mais les scènes complexes restent délicates, et les matériaux “difficiles” (verre, métal poli, tissus semi-translucides) posent problème. La clé : des garde-fous techniques et des routines de test.

Sur les casques, une scène fluide dépend d’assets légers. Les LOD, le baking, la réduction polygonale et des astuces de lighting font la différence. Les articles pratiques comme réinitialiser le Quest 2 aident aussi à s’assurer qu’un problème vient bien de l’asset, pas du device. Côté PC, des recommandations comme optimiser les performances sécurisent les démos professionnelles.

Playbook pour des modèles 3D IA plus convaincants

Un “playbook” minimal s’impose pour éviter les mauvaises surprises. Il concerne autant l’étape photo que l’intégration VR et les tests utilisateurs.

- 💡 Lumière : privilégier une lumière diffuse pour des textures propres.

- 🧱 Fond : détacher l’objet du décor, éviter les reflets parasites.

- 🧰 Nettoyage : corriger normales, vérifier UV, supprimer artefacts.

- 🧮 LOD : trois niveaux minimum pour la VR, transitions douces.

- 🎯 Échelle : comparer à un étalon connu pour cohérence en VR.

- 🧪 Tests : sessions courtes et fréquentes, collecte de feedback.

| Problème courant 🧩 | Cause probable 🔎 | Remède rapide 🛠️ |

|---|---|---|

| Textures floues | Photo sous-exposée | Reprendre photo + sharpening léger |

| Bords “mangés” | Délimitation imprécise | Masque plus fin + retopo simple |

| FPS instable | Mesh trop dense | Décimation + LOD + culling |

| Échelle fausse | Référence absente | Étallonage unité métrique |

| Reflets étranges | Matériau mal réglé | PBR métal/roughness correct |

Pour celles et ceux qui s’équipent, les périodes promo restent stratégiques. Les comparatifs d’achats, comme les prix du PSVR2, et les avantages de parrainage côté Meta via les offres de parrainage Oculus aident à réduire le ticket d’entrée. Et si un casque doit être branché au PC pour du debug avancé, voir le bon câble demeure un réflexe.

Insight final : la qualité ne naît pas d’un miracle d’algorithmes, mais d’une discipline d’équipe qui enchaîne des micro-corrections rapides.

Perspectives créatives entre réalité virtuelle et réalité augmentée

À l’échelle de l’écosystème, la conjonction IA + VR + AR dessine un futur très concret. Les mondes sociaux ambitionnent d’être sensibles au contexte : un objet photographié sur mobile apparaît aussitôt sur la table de la salle virtuelle, manipulable à plusieurs et prêt à être “pinné” dans un inventaire partagé. Les plateformes culturelles et éducatives s’y projettent, avec des visites hybrides mêlant présence physique et annotations AR.

Les avatars deviennent eux aussi plus réalistes, avec des solutions offrant des riggings cohérents, des mains expressives et des mouvements plausibles. L’intelligence artificielle alimente la cohérence : l’objet scanné n’est pas qu’un mesh, il “sait” qu’il est une chaise, un vase, un instrument, et propose des interactions adaptées. Les entreprises explorent ce continuum, soutenues par des analyses comme l’usage croisé VR, IA et exosquelettes.

Itinéraires pour se lancer ou monter en puissance

Le bon point d’entrée dépend du public et des objectifs. Une salle VR locale peut organiser un atelier “photo-to-3D” avec restitution en fin de journée, pendant qu’un studio indie assemble une vertical slice avec trois props IA et un héros scanné manuellement. Les contenus éditoriaux aident à naviguer : des idées de films à vivre sur casque via films pour Oculus Quest 2 aux promenades culturelles comme une plongée virtuelle chez Montaigne.

- 🧭 Définir l’expérience : usage ludique, éducatif, productif.

- 🧱 Choisir la techno : IA 1-photo pour props, capture lourde pour héros.

- 🧑🤝🧑 Co-création : ateliers publics, retours utilisateurs rapides.

- 🔁 Itérations courtes : un sprint = un objet + un test VR.

- 📚 Veille : surveiller sorties, patchs et benchmarks.

| Profil 🔎 | Piste de départ 🛤️ | Objectif 30 jours 🎯 |

|---|---|---|

| Salle VR/loisirs | Atelier photo→objet | Mini-expo d’objets locaux |

| Studio indie | Vertical slice IA | Prototype jouable avec 5 props |

| Entreprise | Catalogue RA/VR | Parcours formation d’1 h |

| Médiation | Visite patrimoniale | Vitrine interactive en ligne |

| Éducation | Kit labo virtuel | TP guidé sécurisé |

Insight final : le terrain de jeu s’élargit et récompense ceux qui osent des prototypes réguliers, partagés et commentés, plutôt que de viser d’emblée le chef-d’œuvre.

Peut-on vraiment créer des objets 3D convaincants à partir d’une seule photo ?

Oui, pour des objets simples à moyens, la génération IA type SAM 3D reconstruit un volume et une texture crédibles en quelques secondes. Pour des matériaux complexes (verre, métal poli) ou des détails extrêmes, une retouche et parfois une capture plus complète restent recommandées.

Comment intégrer rapidement un modèle généré dans une scène VR ?

Exporter en format standard (FBX/GLB), vérifier les UV, créer des LOD, puis importer dans Unity/Unreal. Tester l’échelle, les collisions et l’illumination. Un câble fiable pour le debug (voir guide cable Quest 2) et le mode développeur accélèrent les itérations.

Quels sont les principaux bénéfices pour un studio indépendant ?

Un time-to-scene très court, la possibilité d’itérer souvent, et une réduction des coûts de prototypage. L’IA libère du temps pour le game design, la narration et l’équilibrage des puzzles.

En quoi la réalité augmentée profite-t-elle de cette modélisation automatique ?

Les objets générés sont légers et faciles à placer dans un environnement réel via RA. Cela permet des essais produits à domicile, des fiches techniques interactives et des scénarios de formation en contexte.

Que faire si la qualité n’est pas au rendez-vous ?

Reprendre la photo sous meilleure lumière, affiner la sélection de l’objet, corriger les UV, ajouter des LOD et revoir les matériaux PBR. Si besoin, combiner avec une capture plus traditionnelle pour les pièces critiques.

Lila explore les frontières entre fiction et réalité dans les expériences immersives. Elle adore décrypter ce qui rend un jeu ou un escape game réellement captivant. Toujours à l’affût d’innovations, elle transmet sa passion avec un enthousiasme contagieux.

Tao Vortex

27 novembre 2025 at 17h18

L’IA rend la création 3D plus accessible et rapide!

Zephyr Quillon

27 novembre 2025 at 20h07

Article fascinant sur l’impact de l’IA en VR, vraiment captivant !

Zephyra Lumina

27 novembre 2025 at 20h07

L’IA 3D révolutionne l’art numérique ! Bravo !